NEWS | テクノロジー

2024.12.12 13:13

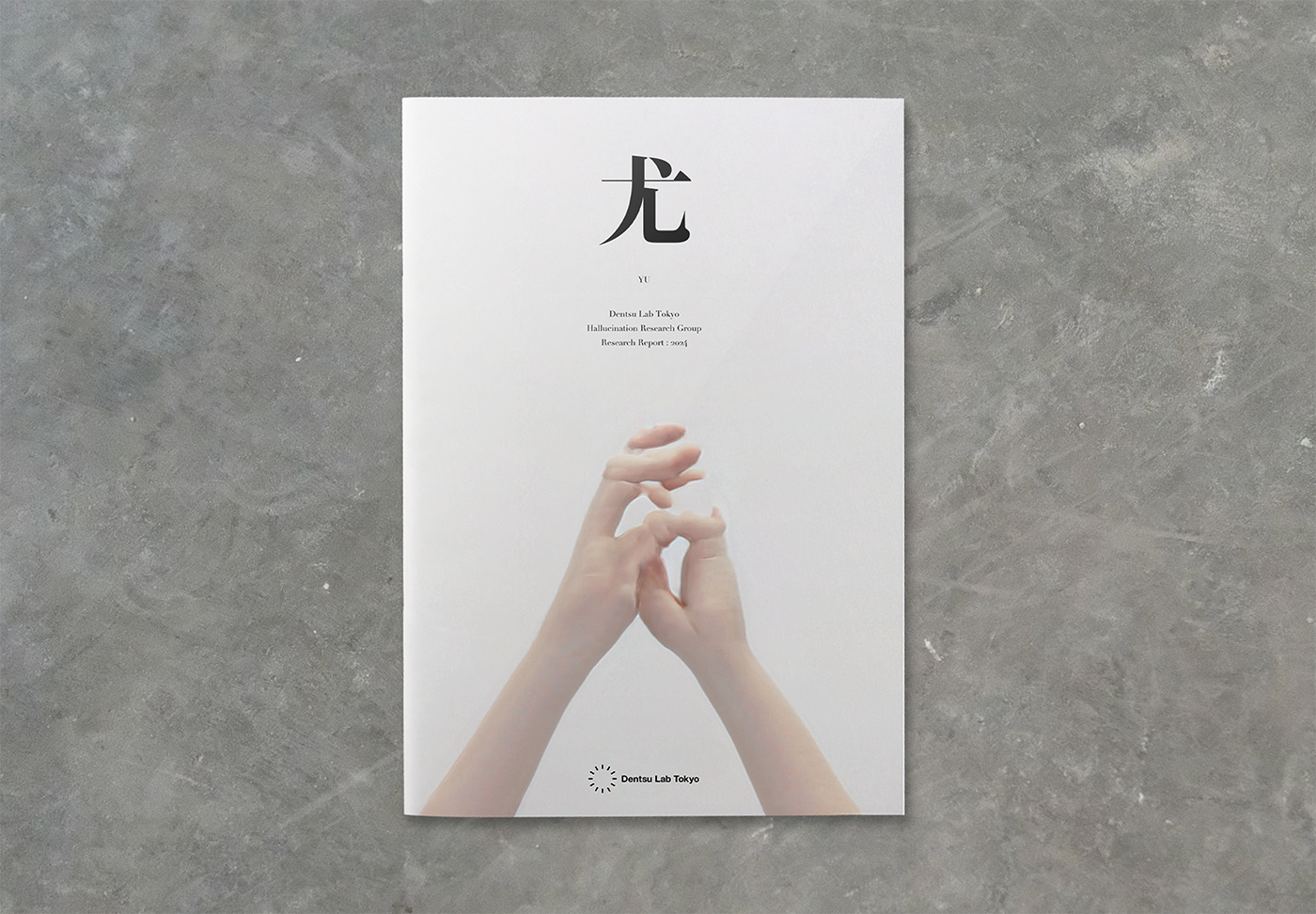

電通のR&D組織 Dentsu Lab Tokyoは、AIが事実に基づかない情報を出力する現象「ハルシネーション(Hallucination)」を標本化するR&Dプロジェクトを発足し、これを収集した2024年度の研究報告書「尤(ゆう)」を発行した。

AIの開発や実用化が目覚ましい昨今だが、AIが出力する情報がすべて正しいとは限らない。たとえば、対話型AIが不正確な情報を本当であるかのように返答する、画像生成AIが素手でスパゲティを食べるような画像を生成する、といった誤認識の事例がよく知られている。こうしたAIが引き起こすエラー=ハルシネーションは、世界的な問題となりつつある。

その原因のひとつとして考えられるのが、AIのトレーニングに使われる教師データの「偏り」である。これにより、画像の認識精度が低くなる、誤検知やステレオタイプ的な認識が発生する、などの問題が起きてしまうのだ。

それを単に技術的な問題だと片づけることも可能だが、Dentsu Lab Tokyoはむしろ、潜在的に存在していたさまざまなバイアスがAI技術によって露出したものだと想定する。ただのエラーと捉えるのではなく、なぜそのような問題が起こったのかを分析し、AIによる誤認識をクリエイティブに捉えることが同社のねらいである。

ハルシネーション自体は開発者の取り組みにより減少傾向にあり、2024年に観測されている多くものは数年のうちになくなるはずだ。それでも同研究プロジェクトでは、それらには時代を反映する資料価値があるとして、意図的に古いバージョンの生成AIアルゴリズムなどを使いながらハルシネーションを収集・標本化した。

「尤」は1000部限定で発行、関連イベントなどで配布される予定。かつての8bit家庭用ゲーム機の画像がもつ独特のグラフィック感覚や、フィルムカメラ特有の色合いやボケ、ブレ、光漏れ、フィルムの粒子感といった、当時の技術的限界がもたらしたエラーが私たちを魅了したように、同書に収められたハルシネーションの数々も、やがて私たちの新たな創造性を刺激する要素になるかもしれない。![]()