NEWS | サイエンス

2021.01.29 17:08

東京工業大学 科学技術創成研究院の吉村奈津江准教授(JSTさきがけ研究者兼務)、明石航大学院生(研究当時)、神原裕行助教、緒方洋輔特任助教(研究当時)、小池康晴教授、ルドビコ・ミナチ特定准教授は、頭皮で記録された脳波信号(EEG)から音声を直接再構築するために有望な手法を開発した。

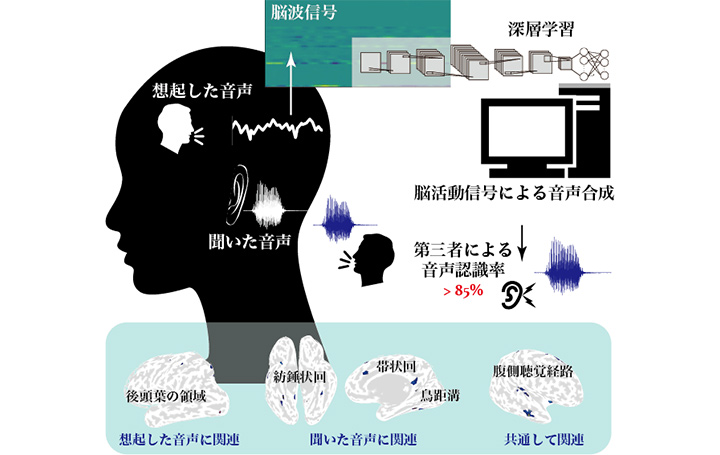

同手法では、まず、参加者が2つの母音「ア」と「イ」を視聴後に思い出したときに記録されたEEGを用いて、聞かせた音源のパラメータを畳み込みニューラルネットワーク(CNN)によって推定。

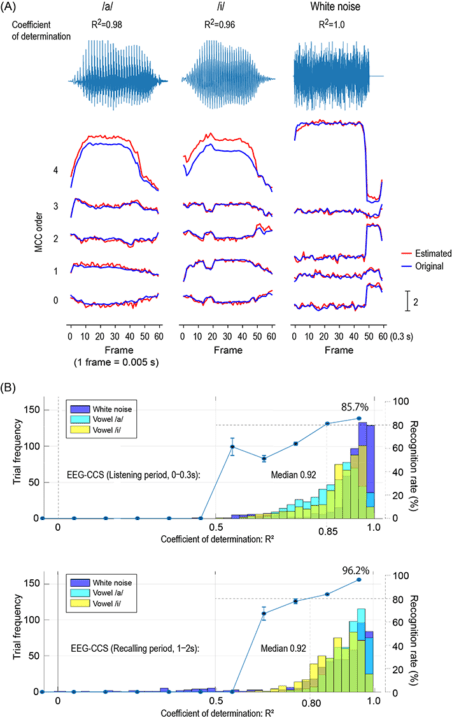

▲EEGから推定した音源パラメータ波形と復元した音声の聞き取り精度を示した結果

(A)元の音源パラメータ波形(青)とEEGから推定した波形(赤)の比較(R2=1で、完全一致)

(B)音を聞いた時のEEG(上)と、音を思い出した時のEEG(下)、でどの参加者も高いR2分布を示した。「ア」と「イ」の違いはR2が0.8を超えると80%以上の確率で聞き分けられた。

推定されたパラメータを用いて復元した母音の音声は非常に明瞭で、実際に視聴した者とは別の参加者が音声の弁別を行ったところ、85%を超える認識率を示す音声だったという。

さらに、音源パラメータの推定のためにCNNが抽出した脳波の特徴を調べることで、音声を聞いている時とそれを想起している時の脳活動領域の違いが示唆されたそうだ。

この手法は、その人がどのように聞こえているか、聞こえていないのかを客観的に把握し、さらに脳のどこを使っているのかを調べられる可能性があるため、EEGを利用した脳内の聴覚・音声・言語処理の評価が可能になる効果が期待されている。

そして、ブレイン・コンピュータ・インターフェイスなどのさまざまな将来のアプリケーションへの道を開く可能性があるとしている。![]()